La risposta perfetta? L’AI non ce la dà

Una decina di anni fa (più precisamente tra la fine degli anni ‘70 e l’inizio degli anni ‘80), esisteva un programma per computer chiamato Wordstar. È stato uno dei primi programmi di videoscrittura sul mercato e, in un certo senso, ha decretato anche l’inizio della fine delle macchine per scrivere come strumento tecnologico tipico degli uffici.

Alcuni anni dopo, nel 1983, arrivò sul mercato la prima versione dell’elaboratore di testi dell’azienda Microsoft, chiamato Word, il quale, come sappiamo, col tempo è diventato il prodotto dominante in questa categoria.

Tra le tante innovazioni introdotte con l’arrivo di Word, vorrei richiamare l’attenzione sul suo dizionario. All’inizio, il programma permetteva di verificare se si erano commessi errori durante la digitazione delle parole. Era anche possibile aggiungere nuove parole al dizionario, in modo che Word non le identificasse come potenzialmente errate nelle future verifiche di altri testi. In altre parole, Word ha “imparato” a partire dalle conoscenze degli utenti.

Questo tipo di funzionalità si è evoluta ed è diventata sempre più sofisticata nelle versioni successive di Word. Oggi, ad esempio, è possibile scrivere solo una parte di una parola e il programma suggerisce il resto, corregge gli errori grammaticali e di battitura, suggerisce intere frasi e così via.

Ho ricordato questo contesto storico solo per sottolineare che l’introduzione di quei programmi e delle loro funzionalità rappresentavano già gli embrioni di quello che è noto come machine learning

(cioè apprendimento automatico) e, soprattutto, delle applicazioni di intelligenza artificiale, che oggi sembra essere la nuova frontiera delle tecnologie digitali.

Tuttavia, se da un lato l’introduzione di alcune risorse tecnologiche ha portato molti e innegabili vantaggi pratici alla nostra vita quotidiana, dall’altro ci sono diversi aspetti che meritano una maggiore attenzione. Tra questi, si può citare ad esempio una riduzione della capacità di analisi critica dei giovani e una perdita (o mancanza) di conoscenza nella padronanza delle strutture linguistiche. Uno dei pensieri che attraversa la mente di molti giovani è: «Perché dovrei preoccuparmi di imparare a scrivere correttamente se Word mi aiuta a correggere e rifinire tutto?».

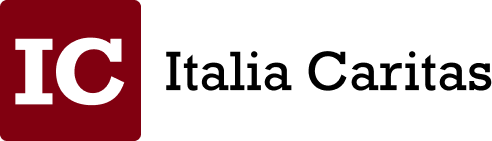

Allo stesso modo, con l’arrivo di Twitter (oggi X) nel 2006, è stata introdotta anche l’idea di testi molto brevi nelle comunicazioni digitali (inizialmente c’era un massimo di 140 caratteri per messaggio e successivamente, nel 2017, questo limite è stato portato a 280 caratteri). Questo scenario ha creato l’idea che testi che superassero quel numero di caratteri fossero troppo lunghi da leggere. Si tratta di una questione importante perché rivela una difficoltà e una mancanza di interesse della generazione nata e cresciuta nell’era della tecnologia digitale a leggere qualsiasi cosa superi la lunghezza di un tweet (ad esempio libri, riviste, giornali ecc.).

Ma la lettura è una attività molto importante per lo sviluppo intellettuale e linguistico di tutti noi. Quando questa capacità è sottovalutata o disprezzata, l’impatto sul livello culturale della società è significativo.

Ora, con l’arrivo di strumenti ancora più potenti come le applicazioni basate su web ChatGPT di OpenAI, Gemini di Google e Bing AI di Microsoft, tra tanti altri, ci rendiamo conto che dobbiamo essere ancora più vigili.

È anche importante sottolineare che non si tratta di essere contrari ai progressi tecnologici, ma di essere consapevoli dei potenziali impatti negativi associati a queste tecnologie, come ha recentemente avvertito il Segretario Generale delle Nazioni Unite, Antonio Guterres, al Vertice di Londra sull’Intelligenza Artificiale (novembre 2023). Inoltre, non è un caso che nel marzo 2023, oltre mille voci influenti sulla scena internazionale hanno firmato un manifesto a favore di un embargo contro questi progressi, proprio per consentire alla società di comprendere in modo più chiaro e deciso i loro potenziali impatti negativi.

In questo contesto, vorrei sottolineare un recente argomento apparso sui giornali francesi riguardo alla revisione dei progetti educativi che propongono la completa sostituzione dei materiali didattici cartacei con i tablet. Secondo gli articoli, anni fa la Svezia aveva già investito una somma considerevole di soldi in un’iniziativa simile per adottare questa strategia educativa, ma ha deciso di annullarla e tornare indietro. Il fatto è che sia in Francia che in Svezia, i risultati positivi attesi nello sviluppo educativo dei bambini non si sono concretizzati. Per di più, molti di loro non erano nemmeno in grado di scrivere correttamente, essendo abituati a digitare testi solo su schermi tattili.

Alla luce di ciò, ci rendiamo conto che la padronanza di alcune basi è molto importante per il pieno sviluppo critico e intellettuale delle persone fin dalla giovane età.

Per quanto possa sembrare favoloso essere in grado di generare automaticamente un testo completo con risorse di applicazione di intelligenza artificiale, questo non è tutto.

Se la persona non conosce i fondamenti minimi della capacità di analisi critica indipendente e originale, non sarà in grado di valutare la qualità, la rilevanza e persino il grado di accuratezza di ciò che l’intelligenza artificiale fornisce come risultato.

In questo contesto, qualche settimana fa ho condotto io stesso un piccolo esperimento non scientifico con una di queste potenti applicazione di AI, con l’obiettivo di valutare la qualità delle risposte generate da essa. Ho posto le domande in modo molto dettagliato e strutturato, chiedendole di scrivere due brevi articoli (500-600 parole circa ciascuno) su argomenti legati alla sociologia (la mia area di formazione) e di fornire anche i riferimenti bibliografici.

Naturalmente, entrambi i testi sono stati scritti a una velocità impressionante di pochi secondi, e questo davvero stupisce. A un primo sguardo veloce, gli articoli sembravano anche vagamente interessanti. Tuttavia, un esame più attento e accurato ha rivelato la ripetizione di argomenti, scritti in modi diversi, il che ha compromesso il flusso delle idee. Anche le conclusioni non erano sufficientemente solide.

In generale, ne ho ricavato l’impressione che l’applicazione di AI eseguisse una potente operazione di copia-incolla partendo da fonti diverse, ma senza un’analisi critica capace di tessere una catena logica di idee. Infine, diverse voci elencate nei riferimenti bibliografici erano imprecise. In altre parole, quando le ho cercate nei database accademici, molte di esse semplicemente non esistevano.

Questo piccolo esperimento ha dunque rivelato che se l’utente non dispone degli elementi minimi necessari per valutare la qualità, la precisione e la reale utilità della risposta generata per le applicazioni di AI, può arrivare a credere che essa sia la verità assoluta.

Un’altra situazione particolare che si è creata con l’emergere di queste tecnologie è che alcune pubblicazioni scientifiche ora richiedono agli autori degli articoli di dichiarare se il loro lavoro presentato sia stato fatto con o senza l’aiuto di strumenti di intelligenza artificiale. Non è ancora molto chiaro in che misura una eventuale dichiarazione positiva sull’uso dell’AI possa influenzare l’accettazione oppure il rifiuto dell’articolo da parte dei revisori. Resta il fatto che si tratta di un cambiamento significativo nel comportamento e nell’approccio al trattamento degli articoli scientifici.

A proposito: questo articolo è stato sviluppato senza l’aiuto di applicazioni dell’AI!

Ancora in questa stessa linea di pensiero, recentemente oltre 1.500 aziende hanno adottato un protocollo per l’identificazione di foto e video generati con l’aiuto dell’AI per evitare la proliferazione di contenuti fake e ingannevoli per le persone.

Insomma, l’assenza di senso critico riguardo ai risultati ottenuti per l’AI può condurre le persone a una perdita della capacità di svolgere il ruolo di agente attivo nel processo di costruzione della conoscenza e trasferisce questo potere alla tecnologia, diventandone così “ostaggio”.

Pertanto, nel valutare i potenziali impatti negativi di queste tecnologie digitali emergenti, è fondamentale comprendere con chiarezza il grado in cui esse sono effettivamente al nostro servizio o viceversa.

Come si dice spesso in economia, non esiste pranzo gratis e, se viene offerto “senza costo”, allora attenzione: forse il prodotto sei tu.

Inoltre, il fatto che l’AI sia costituita da potenti algoritmi in grado di elaborare, incrociare e combinare un’enorme quantità di dati e informazioni molto più velocemente degli esseri umani per trovare la risposta a una domanda non significa che essa sia infallibile.

Anche perché non si può perdere di vista il fatto che l’AI non crea di per sé conoscenza. Anzi, lavora sulla conoscenza già accumulata dagli esseri umani. Dunque, quello che fa, e lo fa molto bene è vero, è soprattutto gestire questa gigantesca base di informazioni per arrivare a una risposta. Tuttavia, tocca a te, in quanto utente, valutare il grado di accuratezza della combinazione.

Per identificare rischi e difetti è necessario essere in grado di analizzarli in modo critico, come già detto. Altrimenti è come il marinaio di cui parla il filosofo greco Seneca, che disse: «Non c’è vento favorevole per il marinaio che non sa dove andare».